Les chercheurs dans le domaine de l'intelligence artificielle seraient, eux aussi, en train de vivre leur "moment Oppenheimer".

Alors que la grève des acteurs et des scénaristes s’intensifie à Hollywood, la montée en puissance de l’intelligence artificielle s’invite dans de nombreux débats. Christopher Nolan, lui, a choisi son camp : au cours d'une conversation qui a suivi la projection en avant-première de son nouveau film Oppenheimer à New York, il s’est justement exprimé à ce sujet. Il a fait part de son inquiétude à l’égard du développement rapide (et incontrôlé) de l’IA, mais aussi de ses potentielles conséquences sur l’industrie du cinéma.

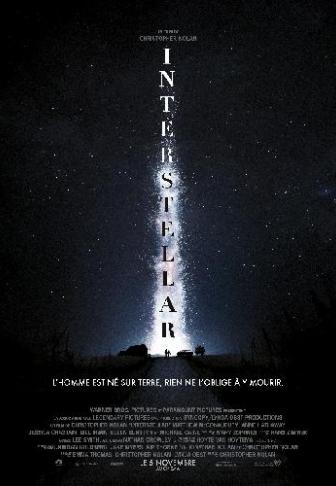

Christopher Nolan ne travaillera pas sur un nouveau film pendant la grève à HollywoodD’après lui, la mise au point de la bombe atomique, relatée dans son nouveau thriller historique, n’est pas sans lien avec l’essor de l’intelligence artificielle : elle devrait même faire office de "mise en garde" pour l'humanité. Lors de l’événement promotionnel, le réalisateur d’Inception et d’Interstellar n’a d’ailleurs pas hésité à pointer du doigt l'irresponsabilité générale autour de ses pratiques :

"Au cours des 15 dernières années, de nombreuses entreprises ont utilisé des mots tels qu'algorithme, sans savoir ce qu'ils signifiaient d'un point de vue mathématique ; ces personnes ne savent pas ce qu'est un algorithme […] Les gens de mon secteur qui en parlent ne veulent tout simplement pas assumer la responsabilité de ce que fait l'algorithme."

"Dire qu'il s'agit d'une entité distincte de la personne qui manie, programme et utilise l'IA, c'est nous condamner. Il s'agit d'une question de responsabilité. Nous devons tenir les gens responsables de ce qu'ils font avec les outils dont ils disposent", a-t-il ajouté.

Si l’histoire adaptée à l’écran de J. Robert Oppenheimer, chargé par les autorités militaires américaines de mettre au point la bombe atomique pendant la Seconde Guerre mondiale, "n’apporte pas des réponses faciles à ces questions", elle permettra selon lui de montrer "où se situent certaines de ces responsabilités". Nolan est même allé jusqu’à évoquer la possibilité "terrifiante" que les systèmes d'IA soient utilisés dans des infrastructures défensives, y compris en tant que responsables des armes nucléaires...

Commentaires